跟踪中国操作系统发展动态,向世界宣传中国操作系统,中国信创产业一定会成功!

图解Windows10+优麒麟双系统安装

为防止超速翻车,建议通读全文后再进行操作。

(此处双系统以 Windows 10+优麒麟 20.04 LTS Pro 为例,其他版本的系统仅供参考)

01

安装前的准备

四小步

第一步:查看电脑基础信息

按”win+r”快捷键回车确认,输入”msinfo32″,回车,出现系统信息界面,可查看 BIOS 模式:

BIOS 有多种模式,此教程以 UEFI 模式为例;

第二步:下载优麒麟镜像

官网下载:(www.ubuntukylin.com/downloads/)

页面下方还有多个开源镜像站下载途径可供选择;

注:下载完成后,为确认优麒麟系统镜像的完整性,可以使用 MD5 校验工具(网页搜索下载即可)验证 MD5 值与官网的是否一致。

第三步:准备一个 U 盘

打开冰箱门,拿出一个新鲜的U盘(或移动硬盘、DVD,此处以 U 盘为例)插在电脑上

要求:U 盘内存大于 4G;

第四步:制作启动盘

此处推荐 Ventoy,下载链接:https://www.lanzoui.com/b01bd54gb

选择结尾为 windows.zip 的最新版本进行下载解压,接着进入解压目录,双击运行 Ventoy2Disk.exe。

运行界面如下图所示:

① 是插入的 U 盘信息;

② 是此 Ventoy 的版本信息;

③ 是 U 盘内的 Ventoy 版本信息(没有安装 Ventoy 的显示为空);

④ 是安装选项,点击安装,就可以将 Ventoy 安装进对应的 U 盘里;

注:此处安装会提示是否格式化,也就是清空 U 盘内的所有数据,请提前将 U 盘原有数据备份。

安装完成后,设备内部 Ventoy 的版本信息就会显示出来,若内部版本低于安装包版本我们可以点击下方的“升级”选择进行升级。

注:升级操作是安全的,不会让 U 盘里已有的镜像文件丢失。

Ventoy 安装成功后,将优麒麟系统的镜像文件复制进到 U 盘,如下图:

此时 U 盘启动盘已经制作完成。以下为启动界面展示图:

02

安装进行时

三大步

第一步:关闭快速启动

如果不关掉可能会存在无法进入 BIOS 的情况

选择“控制面板–硬件和声音–电源选项–选择电源按钮的功能–更改当前不可用的设置”,在关机设置栏下找到“启动快速启动”,取消勾选,然后点击“保存修改”;

第二步:进行磁盘分区

磁盘分区是为了给优麒麟操作系统分配空间,默认选择分区尾部的磁盘(考虑到机械硬盘的读写特性,尽可能切靠前的分区)

首先需要在 Win10 上创建空白磁盘分区,选择“此电脑”–右键点击“管理”。

进入“计算机管理”页,点击“存储>磁盘管理”,选择要分割的磁盘空间,右键点击该磁盘,选择“压缩卷”。

此时会弹出压缩窗口,输入压缩空间量的大小,此处展示约分配 135G (空间分配建议最低不少于 30 G,如果大小不够可以重新分配一下磁盘空间,确保分区空余空间充足,原分区的大小也足够使用)。确认压缩空间量后点击“压缩”。

注:1G=1024MB,为方便计算,可以估算成 1G=1000MB。

压缩结束后,会多出一块可用空间,磁盘分区到此结束。

第三步:正式安装

插入制作好的 U 盘启动盘,重启电脑,在开机时按“F2”进入 BIOS 系统,然后在奇奇的带领下,一步步完成双系统的安装吧~

注:根据不同机型进入 BIOS 系统的快捷键有所不同,请根据自身机型搜索对应的快捷键进行操作。

首先关闭安全启动,通过左右方向键进入“Security”界面,按上下方向键移动到“Secure Boot”选项,回车进入修改状态,按上下键选择“Disabled”,回车确认。

接着通过左右方向键进入“Boot”界面,按上下方向键选择“Boot Option #1”选项卡,回车。选择启动方式为从 USB 启动,即选中自己的 U 盘,回车。

之后通过左右方向键进入“Save & Exit”界面,选择“Save Changes and Exit”,回车。在弹出的选择框里选择“Yes”,回车。

现在电脑开始重新启动,然后你会看到优麒麟开源操作系统安装的准备界面:

稍作等待,进入优麒麟新版安装界面,双击“安装 Kylin”。如下图:

接下来进入安装配置页面–选择语言、时区以及设置用户信息,大家根据自身情况进行设置哦。

直到出现选择安装方式界面,选择“自定义安装”。

注:记住我们是安装双系统,不要点击快速安装,否则有丢失数据的风险!

之后进到分区页面,如下图:

可以看到,系统已经存在 Windows 系统,“空闲”对应的就是我们刚刚压缩出来的空闲分区。 因为我们是安装双系统,所以接下来我们要做的就是将优麒麟系统安装在这个空闲分区内。

选中“空闲”分区–点击最右侧的“添加”按钮,进入新建分区页面。

首先添加根分区,奇奇在此处分配的大小是 80G,大家可以根据自身需求进行分配,但一定要确保之后有充足的空间可供使用,如下图:

由于 Windows 系统已经存在 EFI 引导分区了,所以我们再次不用添加 EFI 引导分区。

之后,添加 data 和 backup 分区,作为数据分区和备份还原分区,此处分别分配 20G。

全部分配完成后点击“下一步”,开始安装优麒麟开源操作系统。

等待安装完成,点击“现在重启”。

重启后便会出现选择系统界面,如下图:

通过上下键选择我们想要进入的系统,回车。到此,双系统已经安装好啦。

怎么样,你安装成功了吗?

03

常见问题解决方案

希望你用不到

Q:如果双系统安装完成后没有启动项选择界面,该怎么解决?

A:可能是启动项出现问题,可以下载安装用 EasyBCD 软件修复启动项。

Q:配置完分区后提示没有根分区、EFI分区、数据备份或还原分区,该怎么办?

A:根分区对应的是“/”,EFI 分区需要在分区时将“用于”类型改为 EFI,数据备份分区对应的是“/data”,还原分区对应的是“/backup”,请根据提示查找对应的分区是否创建。

Q:配置完分区提示“只能存在一个 EFI 分区”,该怎么办?

A:应该是已有的 Windows 系统也存在 EFI 分区,我们需要把自己添加的 EFI 分区进行删除。

Q:笔记本安装完双系统之后,进入 Windows 系统出现花屏,该怎么办?

A:笔记本只有集显,在系统启动时会先加载优麒麟的显卡驱动以用来加载选择系统的界面,致使在选择进入Windows时出现花屏情况

解决办法:首先,进入优麒麟系统中,打开 /etc/default/grub:

将如下语句取消注释即可(删掉 #)。

# Uncomment to disable graphical terminal (grub-pc only)

# GRUB_TERMINAL=console

Q:使用 USB 启动盘安装时,出现”try ubuntu kylin without installation”或“install ubuntu kylin”,Enter 选择“安装”后,显示器黑屏无任何显示,该怎么办?

A:

方法一:显示黑屏,可能是显卡显示的支持有问题,尝试手动修复。

移动光标到”install ubuntu kylin” , 按”e”进入编辑模式,进入命令行模式,

找到”quite splash”然后去掉”—“后,添加“nomodeset”,按 F10 安装。

注:依照不同显卡进行不同显卡驱动选项的添加,此处使用的是Nvidia显卡,添加 nomodeset。

方法二:移动光标到“Try Ubuntu Kylin without installing(safe graphics)”进入安全试用界面尝试使用。

Q:系统安装完成之后,提示未检测到无线网卡,该怎么办?

A:重启,然后在 grub 界面选择高级选项,选择低版本内核,回车,查看网络是否正常:

04

结语

投个票吧投个票吧

如果有什么看不懂的地方,或者在安装过程中出现了文章中未提及的问题,欢迎小伙伴们加入交流群一起探讨,群里不仅有 Linux 忠实爱好者,还有不定时的惊喜福利等你哦~!

扫一扫添加小优微信拉你进群:

如何在统信UOS上流畅运行Photoshop、热门AI工具等Windows应用

不少设计师、程序员和 AI 爱好者在问:Photoshop 能不能跑?AI 编程助手能不能用?有没有适合开发者的工具?

答案是:能,而且体验不错。

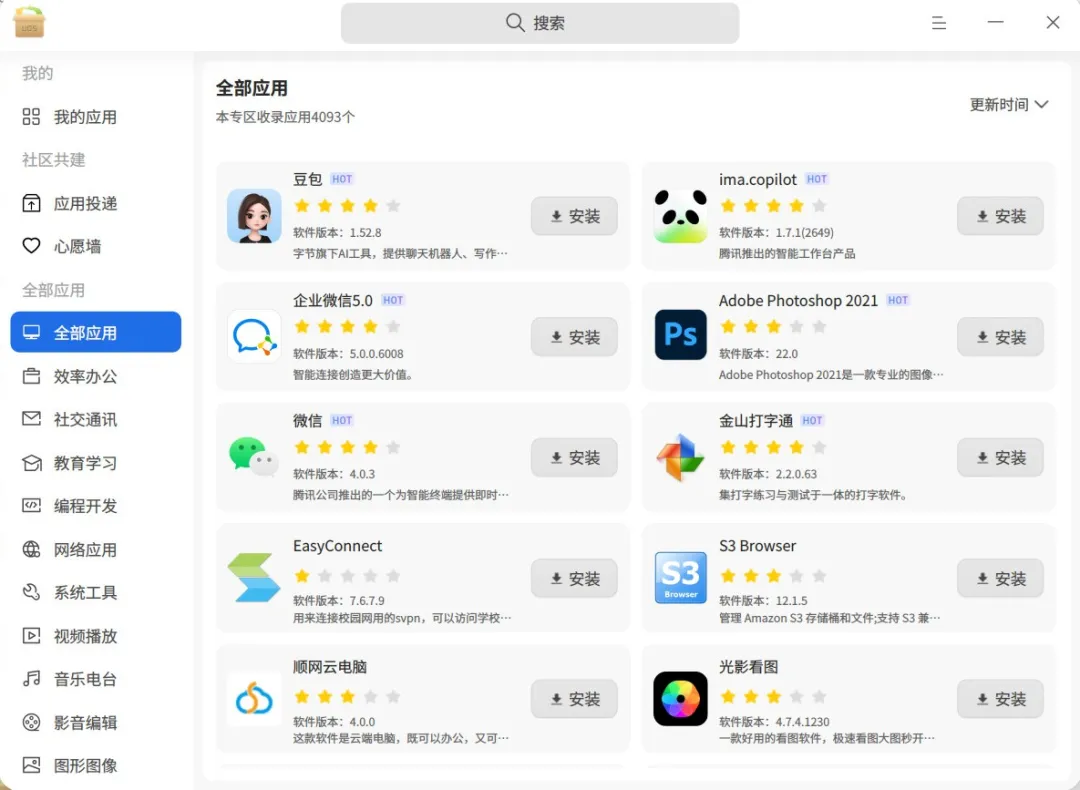

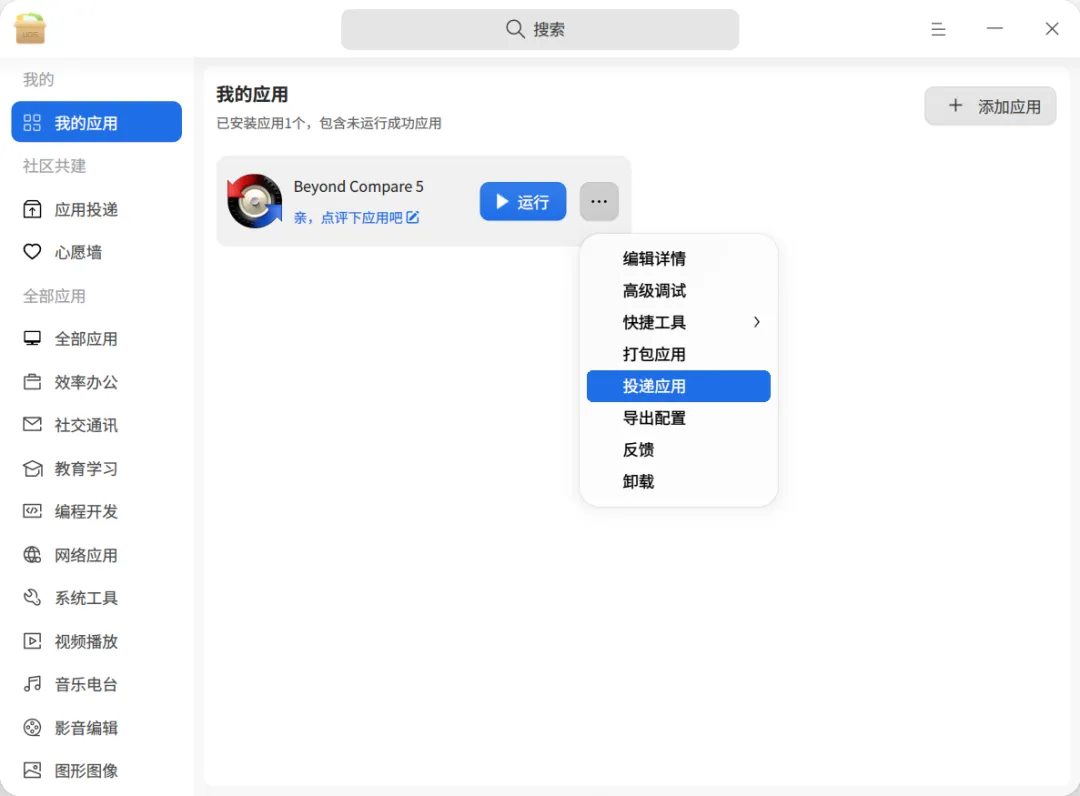

下面这几款创意设计、AI 工具和编程开发应用均已收录在统信 Windows 应用兼容引擎的 “全部应用” 版块中,通过配置文件安装即可稳定运行,无需繁琐的手动调试。

📌 还不熟悉“全部应用”安装方式?可点击回顾《日常必备篇》了解详细安装步骤,三步就能搞定。

UOS

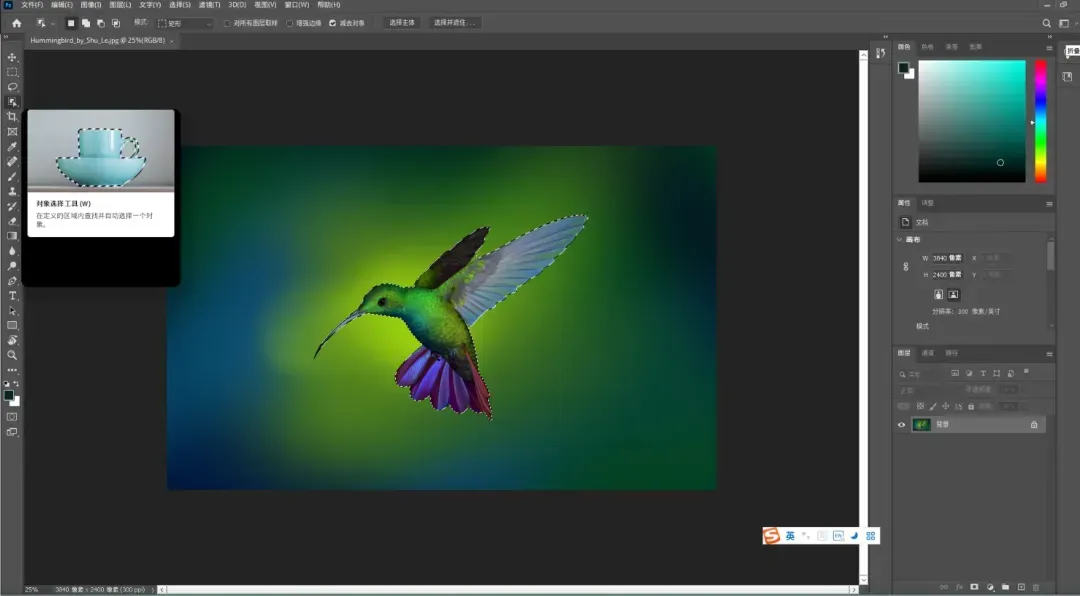

呼声最高的设计软件

Photoshop

Photoshop 是呼声最高的 Windows 软件之一,也是设计师无法绕开的核心工具。统信 Windows 应用兼容引擎团队已完成 Photoshop 2021 的适配支持。

实测体验:基础图片处理如裁剪、调色、图层编辑、蒙版、滤镜等日常操作均能正常使用,长时间运行未出现闪退,保存和导出等关键操作也都能顺利完成。

UOS

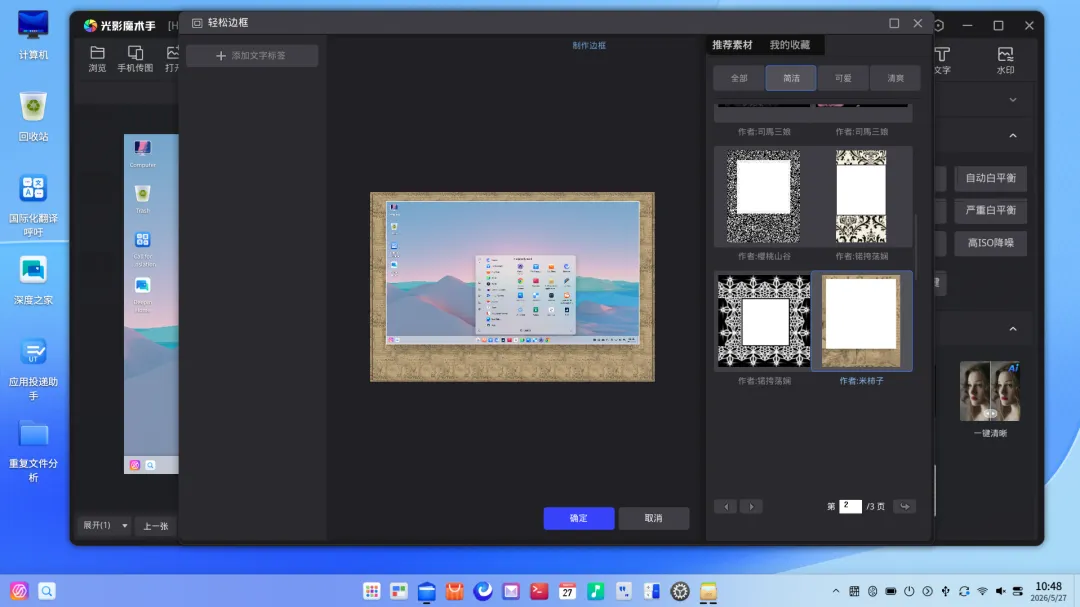

轻量级设计软件

光影魔术手

如果只是偶尔修修图、做做海报,不想背负 Photoshop 的重量,光影魔术手是个绝佳的轻量级替代品。

实测体验:智能抠图可自动识别人像和物品边缘,换背景非常方便;批处理功能则支持批量调整尺寸、加水印、格式转换,适合处理大量照片;整体运行稳定,启动速度快。

UOS

集成多模型的AI客户端

QClaw

支持同时调用多个大语言模型进行对比回答。对于需要评估不同模型输出质量的研究者、开发者来说非常实用。

实测体验:能够正常安装和登录,在不同模型之间切换流畅,对话响应及时,界面显示完整无字体乱码。

UOS

便捷好用的AI助手

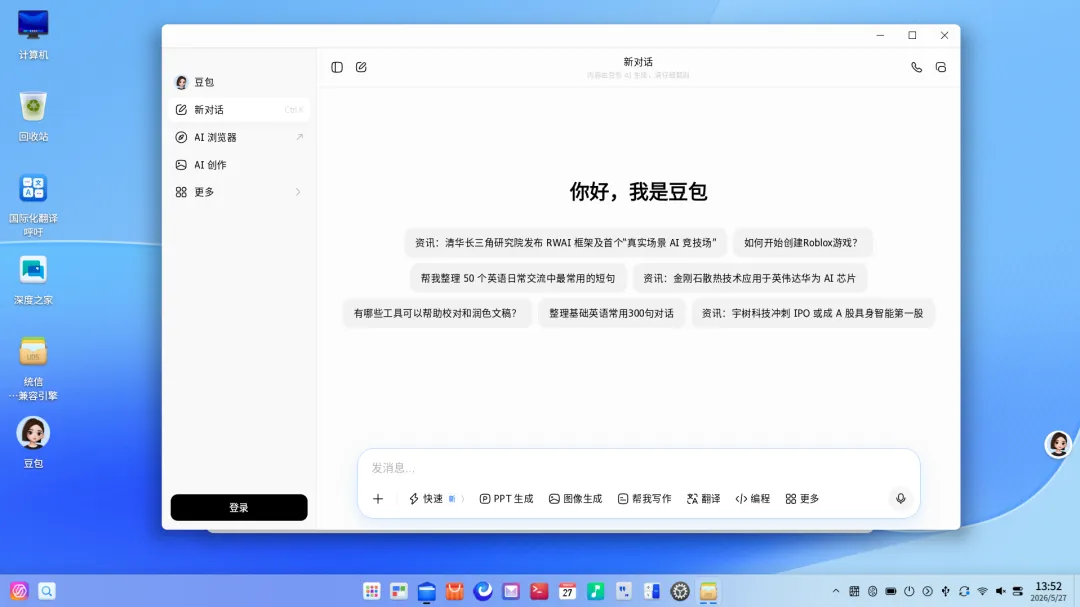

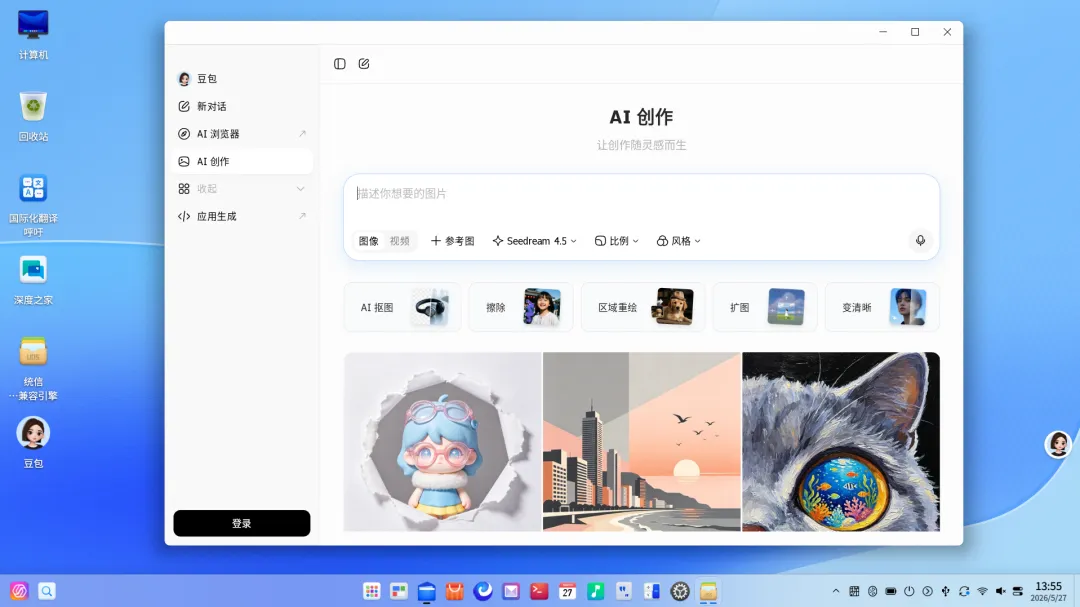

豆包

热门 AI 对话助手,支持闲聊、文案生成、代码辅助等。界面简洁,响应速度快。

实测体验:打开即用,问答流畅,中文理解准确,生成内容质量不错,支持多轮对话且历史记录保存正常。

UOS

智能易用的AI编程助手

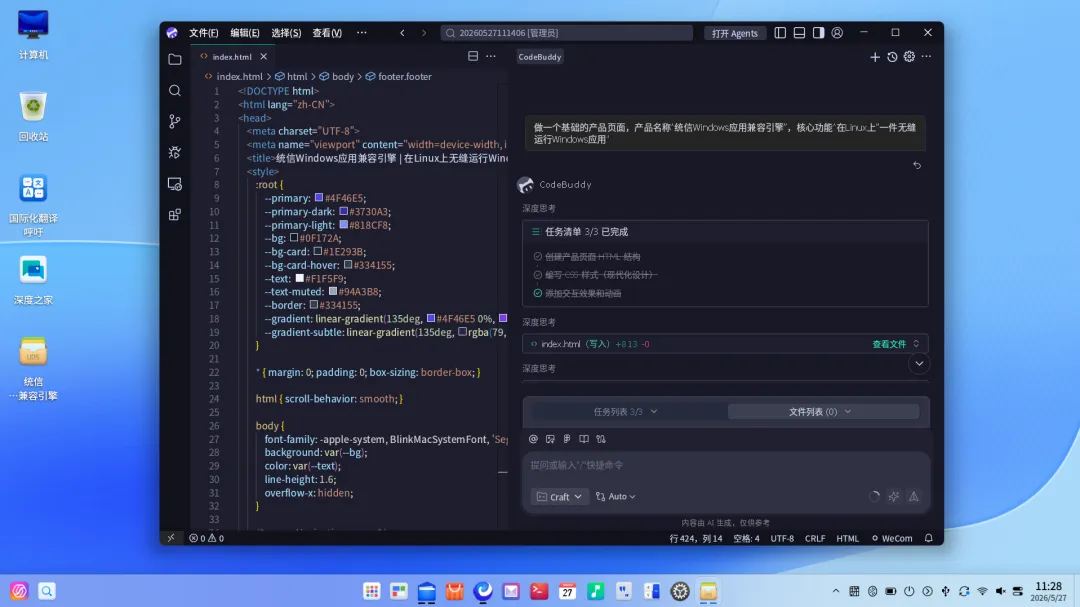

CodeBuddy CN

支持代码补全、解释、调试建议等。可集成在编辑器中使用,大幅提升编码效率。

实测体验:安装后可作为独立窗口运行,也可配合 VS Code 等编辑器使用(通过插件或复制粘贴)。代码补全时 AI 能给出合理建议,选中复杂逻辑能快速给出通俗解释,粘贴报错信息后能分析原因并提供修复方案。

1. 直接下载该版本的 .exe 文件。

2. 双击运行,兼容引擎会自动启动 Wine 环境来执行它。

✅ 运行成功:应用窗口会立刻打开。

❌ 运行失败:会弹出一个提示框,点击“修复”让引擎自动修复常见问题,或点击“查看日志”定位具体错误。详细的调试步骤请参考《兼容引擎-高级调试指南》。

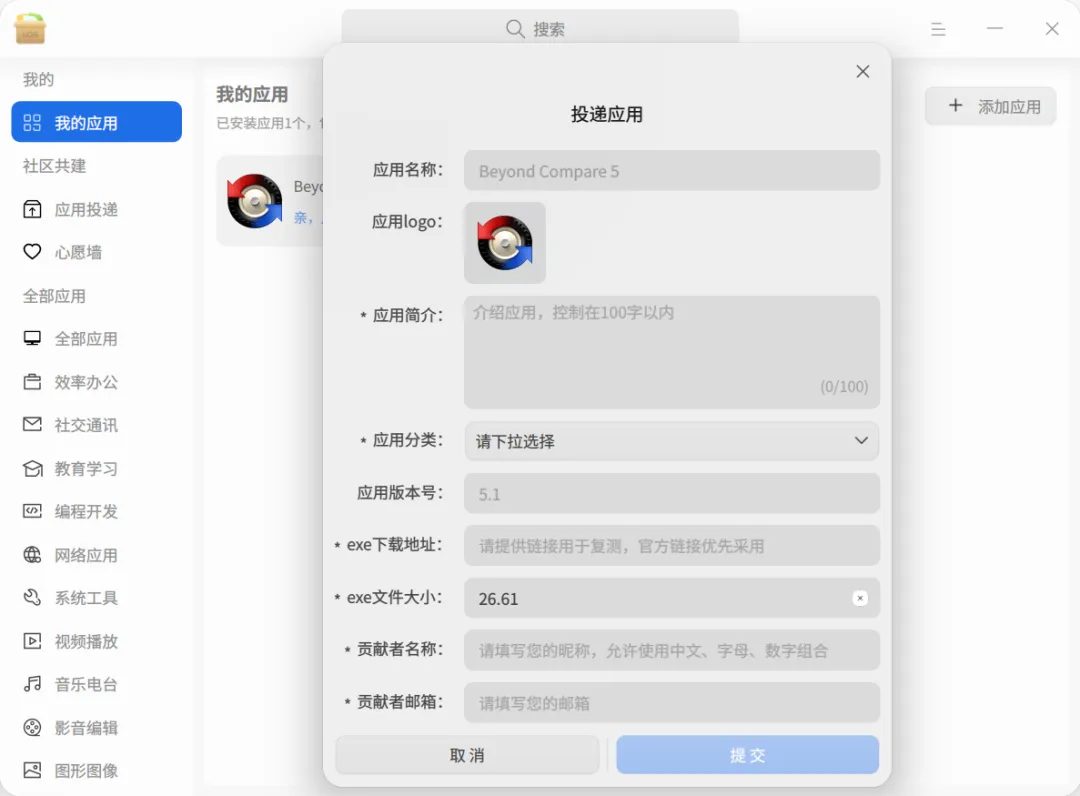

3. 运行成功后,别忘了通过“我的应用” → “投递应用”,将你的配置环境投递给官方。每一次投递,都是在帮助其他用户实现一键安装,也是在让兼容引擎的生态更加丰富。

以上就是本次应用推荐,欢迎下载体验!

若你在使用过程中遇到任何问题,可以在deepin论坛或项目群聊中与我们交流,你的建议是帮助我们不断前进的动力!

加入“deepin生态共建小组(wine)”

编辑审校:公共事务部